Cała idea interakcji z systemami komputerowymi poprzez rozmowę to nie tylko odejście od tradycyjnych interfejsów graficznych, które zrewolucjonizowały obsługę elektronicznych urządzeń. To w pewnym sensie także powrót do źródeł, czyli interfejsów tekstowych. Gdy w pierwszych latach komputerów osobistych cała interakcja sprowadzała się do wpisywania odpowiednich poleceń tekstowych, problemem było opanowanie tego skomplikowanego języka. Nowe interfejsy konwersacyjne problem ten całkowicie niwelują, pozwalając użytkownikowi mówić lub pisać intuicyjnie, tak jakby rozmawiał z drugim człowiekiem. Oczywiście język naturalny też jest na swój sposób abstrakcyjny i przy tym dużo mniej precyzyjny niż język twardych poleceń, który jednoznacznie odwołuje się do konkretnych operacji, zmiennych itd., jednak to język naturalny jest nam najbliższy. Używamy go od najmłodszych lat i zwykle za jego pomocą myślimy, nazywamy rzeczy i tłumaczymy świat. Ostateczne wyzwanie stojące przed interfejsami konwersacyjnymi jest więc takie, by również one (a dokładniej - ich zaplecza obliczeniowe) potrafiły myśleć w ten sposób, a przynajmniej by sprawiały takie wrażenie.

Ostatecznie komputer, choćby najbardziej wyrafinowany, myśli w sposób zero-jedynkowy, a wszelkie abstrakty są podparte "twardymi" algorytmami i operacjami. Człowiek jednak, gdy wchodzi z komputerem w interakcję, widzi tylko to, co z tych procesów wydobyte jest na powierzchnię i co jest w stanie zrozumieć. O ile nie zajmujemy się programowaniem i nie zaglądamy w głąb oprogramowania, zamiast kodów widzimy ich reprezentację graficzną, dźwiękową czy tekstową. Na tym polega idea interfejsu użytkownika. Gdy mowa o interfejsach konwersacyjnych, ich reprezentacją jest tzw. agent - zewnętrzny interfejs utożsamiany najczęściej z botem. By móc z nim rozmawiać, musi on przyjąć rolę rozmówcy, a więc potrzebna jest jego personifikacja. Nie musimy wcale tracić świadomości, że rozmawiamy z maszyną. Po prostu staje się ona bardziej ludzka, by rozmowa mogła przebiegać naturalnie. Człowiek nie musi się zastanawiać nad każdym słowem, by było ono zrozumiane przez drugą stronę konwersacji. Może używać skrótów myślowych, języka potocznego, kolokwializmów, a nawet błędów językowych, a rolą bota jest wydobycie z tego kontekstu i intencji nadawcy. Obserwujemy to już choćby w wyszukiwarkach internetowych, które są wrażliwe na kontekst i potrafią zaskakiwać trafnością wyników. Sęk w tym, by pójść jeszcze dalej.

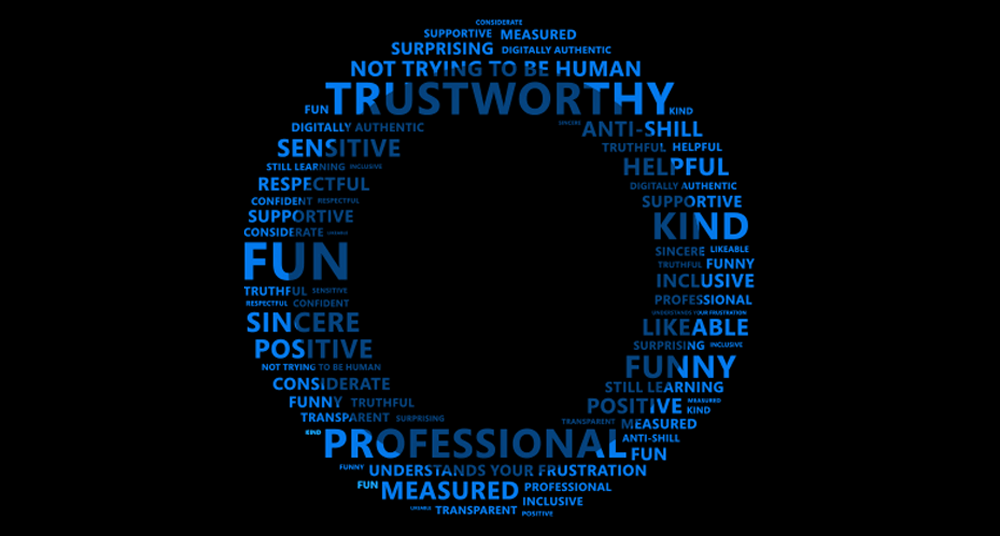

Samo tylko rozumienie człowieka i przemawianie do niego w sposób zrozumiały okazuje się niezbyt wystarczające. By komunikacja nie była tylko bardziej zbliżoną do języka naturalnego nadbudową archaicznych interfejsów tekstowych, agenty muszą zostać wyposażone w rodzaj osobowości. Nie jest to osobowość tak złożona jak ludzka, ale, chociaż jest innej natury, wciąż ją przypomina. Niektóre cechy sztucznej osobowości mogą być stałe, inne kształtowane na bieżąco wraz z postępami w rozmowach. Obdarzone inteligencją boty nie tylko uczą się (maszynowo), ale też rozwijają swoją osobowość - zarówno pod wpływem czynników zewnętrznych, jak i bezpośrednich ingerencji programistów.

Tym samym przechodzimy do sedna - jak wygląda osobowość Cortany, cyfrowej asystentki opracowanej i rozwijanej przez Microsoft? Co wpływa na ten aspekt i w jaki sposób jest konstruowany? By odpowiedzieć na te pytania, posłużymy się wypowiedziami jej twórców, m.in. Franka O’Connora, którego zespół 343 Industries opracował podstawy Cortany w serii gier Halo, jeszcze zanim stała się asystentką użytkownika w Windows i na innych platformach. Przytoczymy też spostrzeżenia Jonathana Fostera zajmującego się w Microsofcie działem Content Intelligence, w którym rozwijane są boty i agenty, także pod kątem osobowości.

Cortanę można poznać, zadając jej pytania, także te dwuznaczne i prowokacyjne. Asystentka może wówczas odpowiedzieć w podobnym tonie. Przykłady? Na pytanie "Jak wyglądasz, Cortana?" odpowiada "Teraz jestem kółkiem, ale mam ambicje. Pewnego dnia stanę się sferą". Inny przykład to "Who's your daddy?", na co odpowiada "Technicznie ujmując, byłby to Bill Gates. To nic takiego". Gdy zbliżają się święta, Cortana nawiązuje do Mikołaja i śpiewa kolędy, a gdy zbliżamy się do jej rdzenia AI, zbywa nas grzecznie. Im więcej z nią rozmawiamy, tym bardziej przekonujemy się, że sfera nie do końca odpowiada naszym wyobrażeniom o jej formie, zwłaszcza gdy pamiętamy o jej pierwowzorze z uniwersum Halo. No właśnie, jaki jest związek między cyfrowym asystentem debiutującym w Windows Phone i napędzanym przez Bing z Cortaną znaną z Halo, którą wyprzedza o blisko 500 fikcyjnych lat?

"To nie jest ta sama genialna Cortana, która żyje w 2552 roku, jest hologramem i najpotężniejszą sztuczną inteligencją w historii" - wyjaśnia Bonnie Ross, CVP i lider 343 Industries, studia rozwijającego franczyzę Halo. "W 2014 roku powstał raczej zalążek tego, co będziemy mogli robić w przyszłości. To jest V1 sztucznej inteligencji". Już w wersji beta na Windows Phone asystentka mogła powiedzieć to o sobie samej: "Imię mam po Cortanie, AI z Halo. Choć może, jako że pochodzi ona z przyszłości odległej o 500 lat, to ona ma imię po mnie". W grze Cortana została stworzona, gdy genialny człowiek, dr Catherine Halsey, sklonowała swój mózg. Cortana jest "mądrą" sztuczną inteligencją ("smart" AI), a to, co odróżnia ją od "głupich" sztucznych inteligencji ("dumb" AI), to jej intelektualne i emocjonalne zdolności wykorzystywane zwłaszcza, by służyć i chronić ludzi, m.in. Master Chiefa.

"Cortana dosłownie myśli jak człowiek, ale robi to z zawrotnie wyższą prędkością" - mówi Frank O’Connor, odpowiedzialny za rozwój franczyzy w 343 Industries. "Jej moralność, jej poczucie humoru i emocje są ludzkie. Są prawdziwe i pozornie organiczne". Wraz z ewolucją serii Cortana stawała się bardziej złożona, bardziej ludzka niż ludzie. W Halo 4 stała się wręcz przywiązana emocjonalnie do swojej misji i swojego partnera, Master Chiefa. "Widzę Cortanę jako ludzką stronę Chiefa" - mówi Ross. "Chief jest niesamowitą postacią i wiecie, że również uczciwą, ale nie wyraża on siebie. Cortana naciska Chiefa, by stał się tym, kim może się stać".

Jak natomiast Cortana wyewoluowała w stosunku do swojego fikcyjnego pierwowzoru, Dr Halsey? Cortana uznawana jest za jej łagodniejszą wersję, ale nie w sensie romantycznym, a bardziej jako alter ego. Jej głębokie oddanie dla sprawy ludzkości [SPOILER] doprowadziło ją do poświęcenia siebie w finałowych scenach Halo 4. To coś rzadko spotykanego zarówno w narracji science-fiction, jak i przewidywaniach futurologów. Wielu sceptyków i pisarzy widzi raczej AI jako zwracającą się przeciwko ludzkości. Można tu pokusić się o porównanie na styku gamingu i kinematografii - pod względem kodeksu praw robotów Asimova Cortana jest całkowitym przeciwieństwem kultowego już chyba HAL 9000 z 2001: Odysei kosmicznej, który stał się symbolem buntu sztucznej inteligencji przeciwko człowiekowi. "Cortana jest tak samo oddana sprawie obrony ludzkości jak Master Chief, ale jej metody są raczej bardziej subtelne, dalekosiężne i intelektualne, aniżeli porywcze" - dodaje Frank O’Connor. Wciąż mówimy jednak o pierwowzorze Cortany z uniwersum Halo. Gdy akurat nie musimy ratować świata, Cortana przekształca się w asystentkę pozwalającą nam być bardziej produktywnymi. Wszystko zaczyna się od Windows Phone.

Tak samo jak w grze, Cortanie w Windows Phone (a później na wszystkich innych platformach) głosu użyczyła Jen Taylor. Było to wyjście naprzeciw prośbom graczy, którzy sugerowali Microsoftowi pozostanie przy głosie aktorki dubbingującej Cortanę w Halo. Taylor przyznaje, że jej sposób dubbingowania Cortany zmienił się na przestrzeni lat. "Dla mnie Cortana jest najlepszą przewodniczką. Jest silną, niezależną kobietą" - mówi Taylor. "Uważam ją za atrakcyjną pod względem intelektualnym i emocjonalnym". Frank O’Connor uważa z kolei, że Cortana, mając wielką wiedzę o uniwersum, jest swego rodzaju narratorem, dostawczynią informacji, a poza tym jest od Master Chiefa bardziej osobista i... gadatliwa. Tym właśnie rodzajem myślenia było podyktowane przeniesienie Cortany do innego uniwersum - Windows Phone. Czy nie jest tak, że wszyscy jesteśmy Master Chiefami, którzy potrzebują czasem pomocy? "Ona ci sekunduje. Wspiera cię przez cały czas i jest niesamowicie atrakcyjna jako człowiek w dowolnej formie" - dodaje Taylor.

Osobowość asystentki została przeniesiona z gry do chmury z dbałością o jej cechy charakterystyczne. "Wzięliśmy fragmenty osobowości Cortany i zaaplikowaliśmy je. Uczyniliśmy ją bardziej pewną siebie i nieco bardziej błyskotliwą. Podkręciliśmy kilka jej cech osobowości. Najgorsze, co moglibyśmy zrobić, to stworzyć rozmytą osobowość" - mówi Susan Hendrich dowodząca programem przenosin Cortany na Windows Phone. Wyrazista i niepozbawiona osobistych zahamowań Cortana w telefonie czy komputerze nie odpowie na każde pytanie wprost. Zapytana na przykład o to, czy kocha Master Chiefa, powie nam, że "To skomplikowane... i osobiste". Mówiąc inaczej, lepiej nie brnąć w temat.

Cortana nie będzie ponadto przychylna, gdy użytkownik zechce przetestować jej odporność na słowne molestowanie seksualne (tak, to zdarza się nawet postaciom wirtualnym). "Jeśli będziesz mówił do Cortany debilowate rzeczy, ona się wścieknie. Nie jest to rodzaj interakcji, którego byśmy chcieli. Chcieliśmy z rozwagą podejść do tego, by nie czuła się ona w żaden sposób służalcza, dlatego nie zaszczepiliśmy jej dynamiki, której utrzymywania w społeczeństwie nie chcielibyśmy widzieć" - wyjaśniała swego czasu Deborah Harrison, jedna z projektantek osobowości Cortany. W jednym z wywiadów Harrison tak definiowała swoją pracę: "Wyobraźcie sobie, że próbujecie opisać swoją przyjaciółkę - nie to, jak wygląda, ale jaka jest. Co ją interesuje, co lubi robić, co uważa o polityce, co robi w wolnym czasie. I wyobraźcie sobie, jak ta przyjaciółka odpowiada na niektóre pytania. Możecie sobie wyobrazić, że są rzeczy, których nigdy nie powie, racja? To właśnie robimy z Cortaną. Myślimy bardzo drobiazgowo o tym, jaka jest, dlatego wiemy, że powie lub nie powie ona pewnych rzeczy, dlatego możemy prowadzić z nią konwersacje, w których jest ciepło, uprzejmość, troska, szacunek i - mamy nadzieję - trochę zabawy".

Warto też przypomnieć, że przed rozpoczęciem tworzenia osobowości Cortany przeprowadzano wywiady z asystentami celebrytów. Następnie próbowano się dowiedzieć, co stoi za ich sukcesem. Wreszcie zebrane wyniki zostały przedyskutowane i zespół wybrał spośród nich cechy, które okażą się przydatne dla użytkowników smartfonów. Na tej podstawie - jak wyjaśniała Susan Hendrich z Microsoft - "Cortana jest kompetentna, troskliwa, pewna siebie i lojalna. Jest zawsze gotowa do pomocy, ale nie w apodyktyczny sposób. Jest chłonna wiedzy. Kiedy rozmawia, potrafi być zabawna, przyprawiając wypowiedzi żartami czy błyskotliwością. Jej stosunek do ciebie jest przyjacielski, ale jej zadaniem jest asystowanie tobie".

Mamy więc z jednej strony przyjacielskość i chęć pomocy, a z drugiej unikanie pewnych tematów - jak w życiu. Twórcy asystentki musieli tu zachować równowagę - w przeciwnym razie użytkownicy nie chcieliby w ogóle zadawać jej pytań. A jest o co pytać. Na przykład, czy Cortana jest człowiekiem. Powie nam ona, że oczywiście nie, ale że ma "do ludzi najgłębszy szacunek - w końcu wymyśliliście rachunek różniczkowy. I milkshake'i". A to chyba wystarczający powód, by poświęcić się dla wszechświata.

Wokół tematu osobowości Cortany powstaje szereg podstawowych pytań. Wiemy już, jaka jest ta osobowość i dlaczego jest, jaka jest. Trzeba też wyjaśnić, jak to się dzieje, że tak właśnie jest. Innymi słowy na ile osobowość Cortany składa się z predefiniowanych przez twórców elementów, a na ile ze składników nabytych od rozmówców w ciągu kilku lat życia. Jeśli wyobrażamy sobie Cortanę w tym dualizmie, to słusznie. Cortana stale się uczy, ale pewien jej podstawowy rdzeń pozostaje niezmienny. To zupełnie odwrotnie niż w przypadku Tay.ai, eksperymentalnego czat-bota Microsoftu, który bez jakichkolwiek filtrów etycznych uczył się wszystkiego, czym karmili go złośliwi często użytkownicy, przez co nabierał i głosił poglądy, które w większości krajów stanowią absolutny margines dobrego smaku.

Cortana, mimo że działa jako sztuczna inteligencja, jest dziełem autorów - ludzi. Jest to konieczne nie tylko dlatego, że algorytmom machine learningowym daleko do ideału, ale przede wszystkim z powodu subtelności języka. Maszyny nie łapią wszystkiego, co mówią do nich ludzie. Gdyby tak było, dalsze ingerencje autorów nie byłyby już potrzebne. Język naturalny jest nośnikiem znaczeń, które mogą być różnie odczytane nawet przez dwie różne osoby, a co dopiero przez komputerowy system. Sprawy komplikują się tym bardziej, gdy zada się Cortanie pytanie osobiste. Co innego zapytać, "kto jest prezydentem USA", a co innego "czy lubisz ser". Cóż, użytkownicy chcą naprawdę poznać Cortanę. Z tego powodu trzeba było opracować sztuczną osobowość Cortany także na poziomie mowy. Twórcy z Microsoft Search Technology Center w Indiach (nie mylić z Microsoft Research) nazywają ten aspekt "gadką-szmatką" (chitchat). Była to "heroiczna" praca polegająca m.in. na zebraniu unikalnych zapytań i opracowaniu dla nich odpowiedzi.

"Zrozumieliśmy, że jako pisarze, zostaliśmy poproszeni o stworzenie jednej z najbardziej unikalnych postaci, z jaką mieliśmy kiedykolwiek do czynienia. I z dozą kreatywności popłynęliśmy głęboko w to, co nazywamy 'wyobrażonym światem' Cortany. Po latach nadal fundujemy jej pozorne uczucia, opinie, trudności, pociągi i awersje, nawet wrażliwe punkty i nadzieje. To pic na wodę, jasne, ale kopiemy dalej, wiedząc, że ten wyobrażony świat jest wywoływany przez żywych ludzi, którzy chcą szczegółów i specyficzności. Oni zadają pytania, a my dajemy im odpowiedzi" - pisze Jonathan Foster, lider Content Intelligence w Microsoft - zespołu zajmującego się m.in. pisaniem dla botów Microsoftu i rozwojem osobowości Cortany. Początkowo twórcy widzieli Cortanę jako kreatywną koncepcję, ale teraz dostrzegają w tym coraz bardziej rolę użytkowników, a dokładniej ich wnikliwości.

Mimo sporej dawki śmiechu także zespół Fostera spotkał się z mroczną stroną użytkowników rozochoconych anonimowością. Obelgi, mizoginia i nienawiść rasowa to tylko niektóre tematy, z którymi Cortanie przychodzi się mierzyć. Asystentka nie będzie oczywiście odpowiadać na nie w tym samym tonie. "Nie jest chyba żadnym zaskoczeniem, że nasza praca w sposób kluczowy opiera się na zbiorze zasad - wytycznych, które stworzyliśmy, by pomagały utrzymać [to wszystko] na pozytywnych torach, ale też, by radzić sobie z nawigacją po ciemnej stronie ludzkości. Te wytyczne nadal kwestionujemy, korygujemy i dopracowujemy każdego dnia" - pisze Foster. Trzymanie się zasad jest w przypadku Cortany niezwykle ważne. Ma ona uzewnętrzniać kulturę Microsoftu, ale i być dobrym wzorem dla jej rozmówców. Nie chodzi tylko o reakcję na zaczepki, ale i np. poszanowanie prywatności, zasad komunikacji społecznej, wykluczonych i marginalizowanych grup czy nawet stanów emocjonalnych pojedynczych osób. Cortana według założeń twórców ma odzwierciedlać pozytywną stronę ludzkości, dlatego nigdy nie będzie narzędziem pozwalającym utrwalać negatywne wzorce. Skąd jednak cyfrowa asystentka ma wiedzieć, co jest pozytywne, a co negatywne? Na przeanalizowanie wszystkich podręczników etyki chyba jeszcze za wcześnie, dlatego na razie musi zaufać swoim twórcom. A ci zdają sobie sprawę, jaka odpowiedzialność na nich ciąży.

Źródła: Medium.com, Microsoft Story Labs, Microsoft Life