Kiedy korzystamy z ChatuGPT albo Copilota i prosimy asystenta AI o wygenerowanie obrazu, to choć za rozmowę odpowiada model LLM (z serii GPT lub o), do tworzenia obrazów wykorzystywany jest oddzielny model - Dall-E. Teraz zaawansowany generator obrazów stał się częścią GPT-4o. Zdaniem wydawcy radzi on sobie lepiej od konkurencyjnych modeli, które nadal mają spore trudności przy niektórych zadaniach.

Generowanie obrazów przez sztuczną inteligencję to jedna z dziedzin, których imponujący rozwój możemy obserwować od kilku lat. Od naprawdę pokracznych plam jak ze snu, po fotorealistyczne obrazy generowane w kilka sekund - taką drogę przeszła ta technologia w krótkim odcinku czasu. Modele generatywne nadal jednak mają problemy z osadzaniem tekstu, logo czy przedmiotami codziennego użytku. Znacznie lepiej sprawdzają się w totalnie odjechanych, surrealistycznych scenach. Przypomina to zresztą początki CGI i komputerowej grafiki 3D.

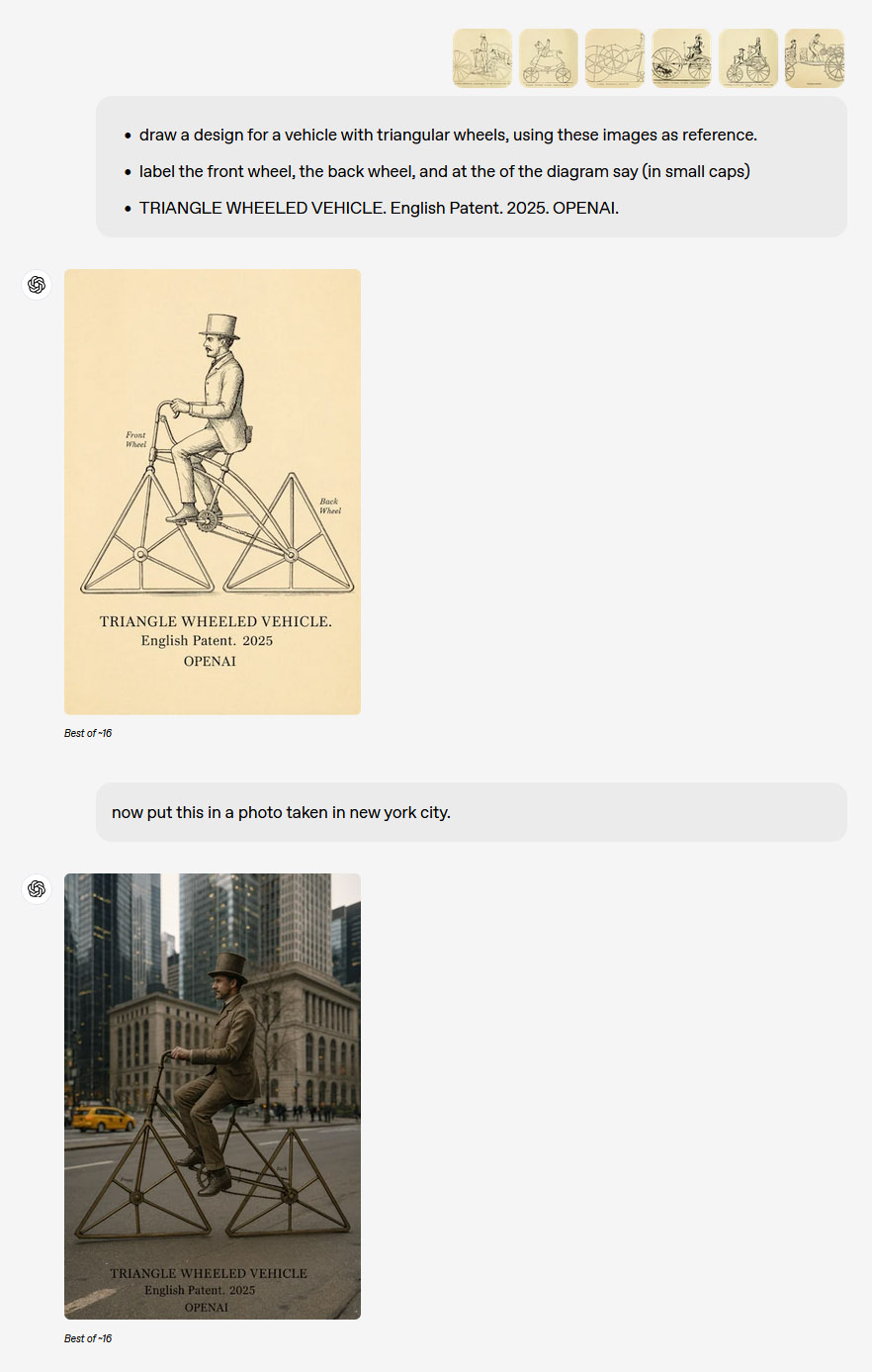

OpenAI twierdzi, że generator obrazów w GPT-4o przezwyciężył typowe ograniczenia, poprawnie renderuje tekst i precyzyjnie podąża za promptem, korzystając ze swojej bazy wiedzy oraz kontekstu czatu. Nowy model AI pozwala tez modyfikować przesłane przez użytkownika obrazy i tworzyć nowe, korzystając z tych przesłanych jako inspiracji.

Nowy model graficzny od OpenAI zaczął być wdrażany u subskrybentów ChatGPT Plus, Pro, Team i Free, a także w narzędziu do generowania wideo Sora. Stanie się on domyślnym generatorem obrazów w ChatGPT, a użytkownicy nie będą musieli niczego klikać przed napisaniem prompta. Mogą oni także dostosowywać wygenerowane obrazy, zmieniać ich proporcje i kolory, a także usuwać tło (podobnie jak w aplikacji Microsoft Designer, opartej jednak nadal na Dall-E 3). W kolejnych tygodniach model trafi też do ChatGPT Enterprise i Edu. Nie wiadomo jeszcze, kiedy trafi do Microsoft Copilota.

Generator obrazów w GPT-4o ma pewne ograniczenia. Tworzy on bardzo szczegółowe grafiki, dlatego zajmuje mu to do minuty. Istnieje też kilka znanych problemów, które OpenAI zamierza naprawić w najbliższych tygodniach i miesiącach. Narzędzie może m.in. przycinać dłuższe obrazy, tworzyć nieprawdziwe informacje, a także mieć trudności z generowaniem obrazów zawierających więcej niż 10-20 różnych konceptów jednocześnie, z renderowaniem języków ze znakami innymi niż łacińskie, dokonywaniem poprawek na wybranych fragmentach obrazu i renderowaniem szczegółowych informacji na małym obszarze.

Obrazy wygenerowane przy pomocy GPT-4o zawierają metadane C2PA. Pozwalają one zidentyfikować, że obraz został wygenerowany przez ten model. OpenAI ma też wbudowane narzędzie, które pozwala to zweryfikować na podstawie atrybutów technicznych grafiki. Wydawca dodaje, że prośby o wygenerowanie treści naruszających zasady w dalszym ciągu będą blokowane. Za pomocą GPT-4o nie wygenerujesz więc szkodliwych i nielegalnych treści.