GitHub Copilot korzysta z różnych dużych modeli językowych (LLMs) do różnych celów. Pierwsza wersja korzystała z Codex, wczesnej wersji GPT-3 dostosowanej do zadań programistycznych. Copilot Chat debiutował w 2023 r. z obsługą GPT-3.5, a następnie GPT-4. Wersje te były aktualizowane wiele razy – od GPT 3.5-turbo po GPT 4o i 4o-mini. Deweloperzy nie muszą jednak ograniczać się do modeli OpenAI.

GitHub Copilot daje programistom wybór modeli od różnych dostawców: Anthropic Claude 3.5 Sonnet, Google Gemini 1.5 Pro oraz OpenAI o1-preview i o1-mini. Te nowe modele zaczną być wdrażane w najbliższym czasie – najpierw w Copilot Chat, z o1-preview i o1-mini dostępnymi już teraz, Claude 3.5 Sonnet w przyszłym tygodniu i Gemini 1.5 Pro w kolejnych tygodniach. Co warto wiedzieć o tych modelach LLM?

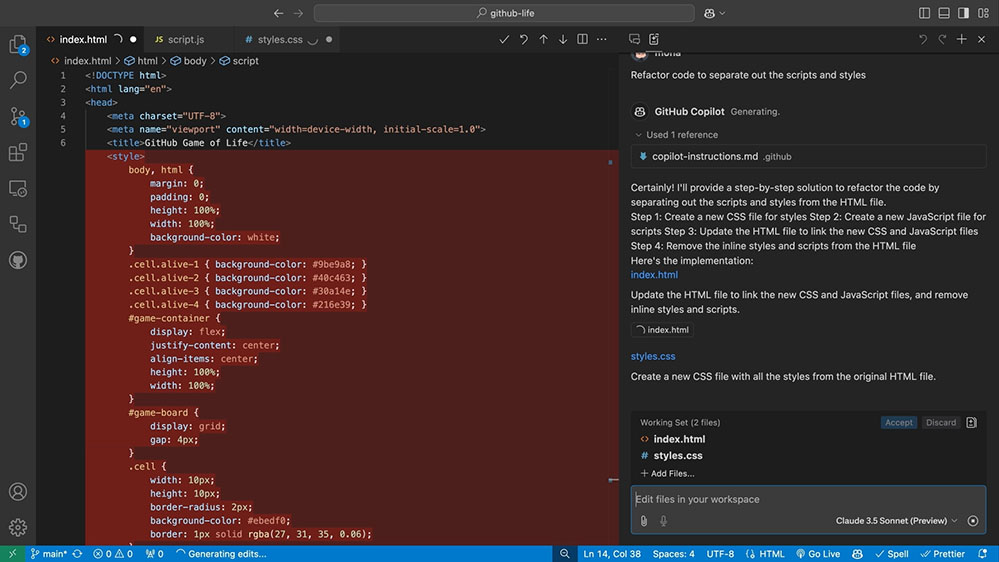

- Anthropic Claude 3.5 Sonnet radzi sobie świetnie z zadaniami koderskimi we wszystkich etapach cyklu życia oprogramowania – od wstępnego projektu, po poprawianie błędów, utrzymanie i optymalizacje. Claude 3.5 Sonnet demonstruje wysokie umiejętności obsługi skomplikowanych i wieloetapowych zadań kodowania, zajmując się wszystkim – począwszy od aktualizacji starszych aplikacji, przez refaktoryzację kodu, po rozwój funkcji – pisze wydawca.

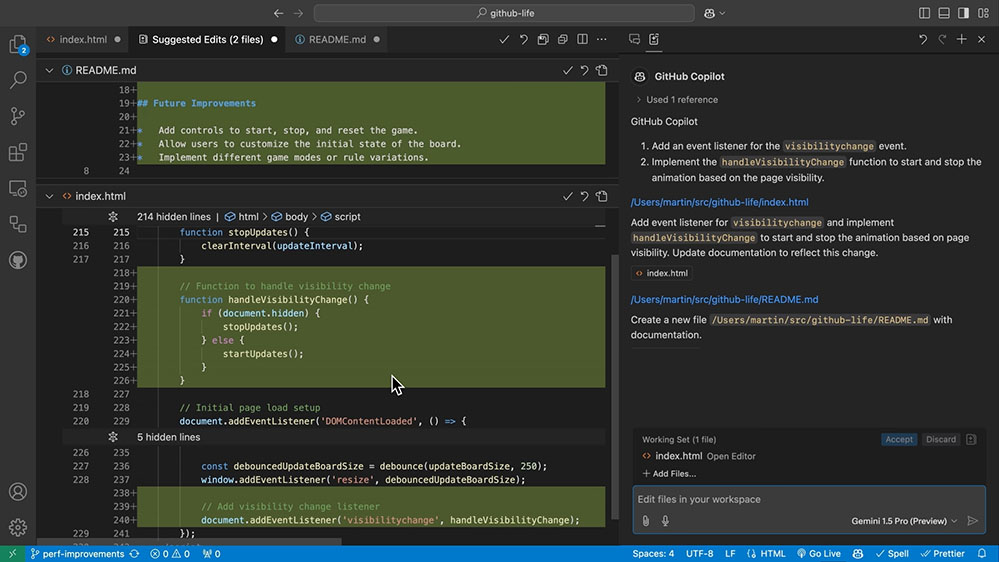

- Google Gemini 1.5 Pro również radzi sobie bardzo dobrze w scenariuszach kodowania. Posiada okno kontekstowe z 2 mln tokenów i jest natywnie multimodalny – z możliwością przetwarzania kodu, obrazów, dźwięku, wideo i tekstu jednocześnie. Cechuje go też wyjątkowo krótki czas odpowiedzi przy sugestiach kodu, dokumentacji i wyjaśnianiu kodu.

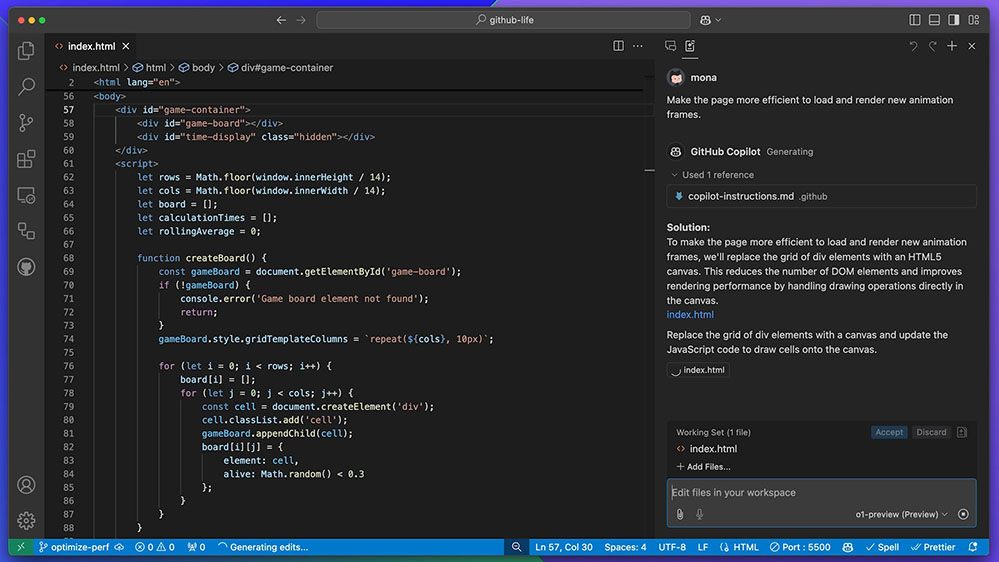

- OpenAI o1-preview i o1-mini należą do nowej serii modeli AI wyposażonych w bardziej zaawansowane możliwości wnioskowania/rozumowania niż GPT 4o. Na etapie eksploracji w GitHub Copilot wydawca usługi zauważył, że umiejętności rozumowania tych modeli pozwalają na głębsze zrozumienie ograniczeń kodu i skrajnych przypadków, co przekłada się na wydajne i wysokiej jakości wyniki.