Microsoft już parę lat temu podkreślał znaczenie odpowiedzialnego i bezpiecznego korzystania ze sztucznej inteligencji. Gigant z Redmond poszedł w ślad za Google i wstrzymał sprzedaż technologii AI odczytujących emocje człowieka na podstawie przetworzonego obrazu. Firma zapowiedziała też, że ograniczy dostęp do technologii rozpoznawania twarzy.

Kluczowym priorytetem zespołu Cognitive Services jest upewnienie się, że jego technologia AI, wliczając w to rozpoznawanie twarzy, jest rozwijana i używana odpowiedzialnie. Chociaż szerzej zaadaptowaliśmy 6 fundamentalnych zasad kierujących naszą pracą w AI, wcześnie zauważyliśmy, że wyjątkowe zagrożenia i możliwości stwarzane przez technologię rozpoznawania twarzy wymagają własnego zestawu zasad.

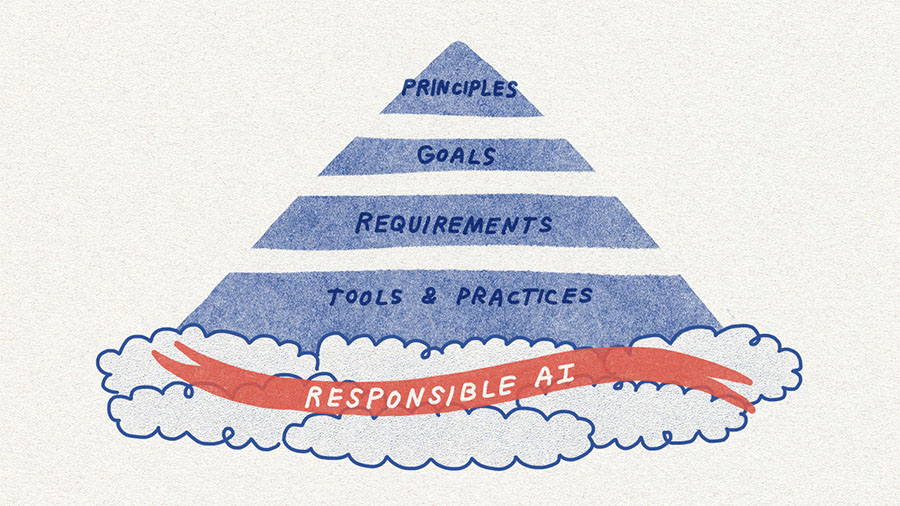

Aby wzmocnić nasze zobowiązanie wobec tych zasad i stworzyć mocniejsze fundamenty na przyszłość, Microsoft ogłasza znaczące aktualizacje swojego Responsible AI Standard, wewnętrznego poradnika, który kieruje rozwojem i wdrażaniem naszych produktów AI. W ramach dostosowywania naszych produktów do tego nowego standardu zaktualizowaliśmy nasze podejście do rozpoznawania twarzy, w tym dodaliśmy nową politykę ograniczonego dostępu, usunęliśmy klasyfikatory AI z wrażliwych atrybutów i wzmocniliśmy nasze inwestycje w uczciwość i przejrzystość.

— Sarah Bird, Principal Group Product Manager w Azure AI, Microsoft

W efekcie tych zmian nowi klienci muszą aplikować o dostęp do funkcji rozpoznawania twarzy, takich jak Azure Face API, Computer Vision i Video Indexer. Z kolei istniejący klienci mają rok na aplikowanie i otrzymanie zgody na dalszy dostęp w oparciu o dostarczone przez nich przypadki użycia. Bez tego zatwierdzenia nie będą mogli korzystać z tych technologii po 30 czerwca 2023 roku. Inne technologie związane z wykrywaniem twarzy (w tym wykrywanie rozmycia, ekspozycji, okularów, pozycji głowy, okluzji etc.) pozostaną dostępne i nie będą wymagać aplikowania.

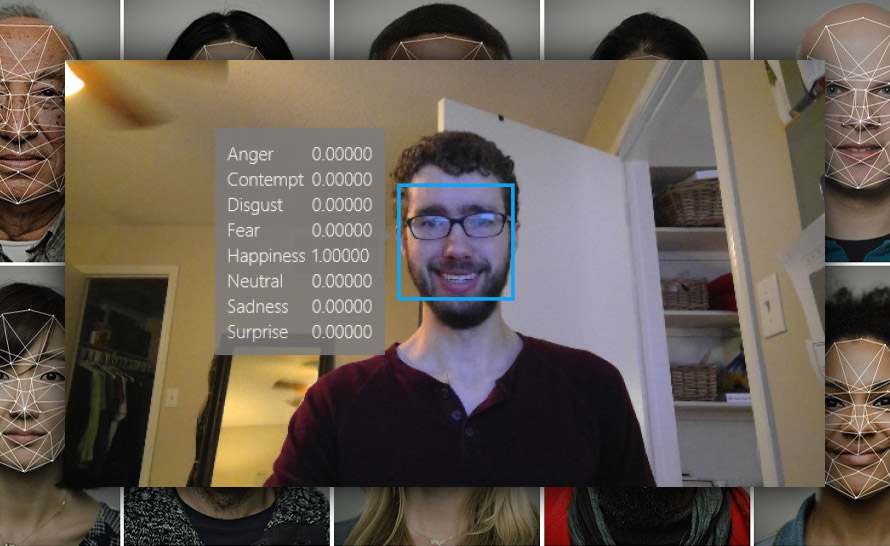

Kolejną zmianą jest wycofanie technologii analizy twarzy, które służą do wnioskowania stanów emocjonalnych i atrybutów tożsamości, takich jak płeć, wiek, uśmiech, zarost, włosy i makijaż. Microsoft współpracował z wewnętrznymi i zewnętrznymi badaczami, by zrozumieć ograniczenia i potencjalne korzyści z tych technologii. Ustalono m.in., że w przypadku klasyfikacji emocji może dochodzić do naruszenia prywatności, a ponadto brak jest uniwersalnego konsensusu dotyczącego "emocji". Nie sposób więc generalizować powiązania między wyrazem twarzy a stanem emocjonalnym osoby w różnych przypadkach użycia, regionach i grupach demograficznych. Poza tym dostęp do funkcji, które przetwarzają "wrażliwe atrybuty", może prowadzić do nadużyć, takich jak stereotypizacja, dyskryminacja czy nieuczciwa odmowa korzystania z usług.

Aby temu zapobiec, Microsoft zdecydował się zakończyć wsparcie dla systemu ogólnego zastosowania w Face API, służącego do wnioskowania stanów emocjonalnych, płci, wieku, uśmiechu, zarostu, włosów i makijażu. Wykrywanie tych atrybutów nie będzie dostępne dla nowych klientów od 21 czerwca 2022 r., a dla istniejących klientów — od 30 czerwca 2023 roku. Firma przewiduje jednak możliwość dalszego używania tych technologii w "zestawie kontrolowanych scenariuszy ułatwień dostępu", jak np. w aplikacji Seeing AI.